Keine Angst, trotz der textlichen Anlehnung an ein bekanntes Bibelzitat (Psalm 23) ist nicht Religion das Thema dieses Beitrags. Auch wenn die persönliche Zustimmung oder Ablehnung von digitalen Sprachassistenten durchaus Züge eines Glaubensbekenntnisses annehmen kann.

So long, Alexa?

Erst vor kurzen häufte sich in sozialen Medien die Meldung, dass Amazons digitaler Sprachassistent Alexa und seine Smart Speaker dem Internetriesen Milliardenverluste bescheren. Mit ihrer Einführung 2014 (2016 im D-A-CH-Raum) drang der Konzern unmittelbar in die privaten Wohnräume ein. Manch böse Zungen meinen, um zu spionieren und Daten abzusaugen. Obwohl das nicht von der Hand zu weisen ist, geht es wohl eher darum das Online Shopping-Erlebnis durch Vernetzung und Sprachsteuerung zu revolutionieren und so weitere Rekordergebnisse zu sichern. Voice Commerce, das bequeme Einkaufen und Bezahlen per Sprachbefehle, ist ja ein Zukunftstrend und wachsender Markt, wenngleich aktuell nur auf niedrigem Niveau. Ökonomisch absolut nachvollziehbar, reagiert Amazon nun mit einem wirtschaftlichen Kahlschlag. Und auch wenn die Abgesänge auf das Produkt Alexa verfrüht erscheinen, ist die Zukunft und insbesondere Weiterentwicklung dieser Sparte mehr als ungewiss.

Unheimliche Technik

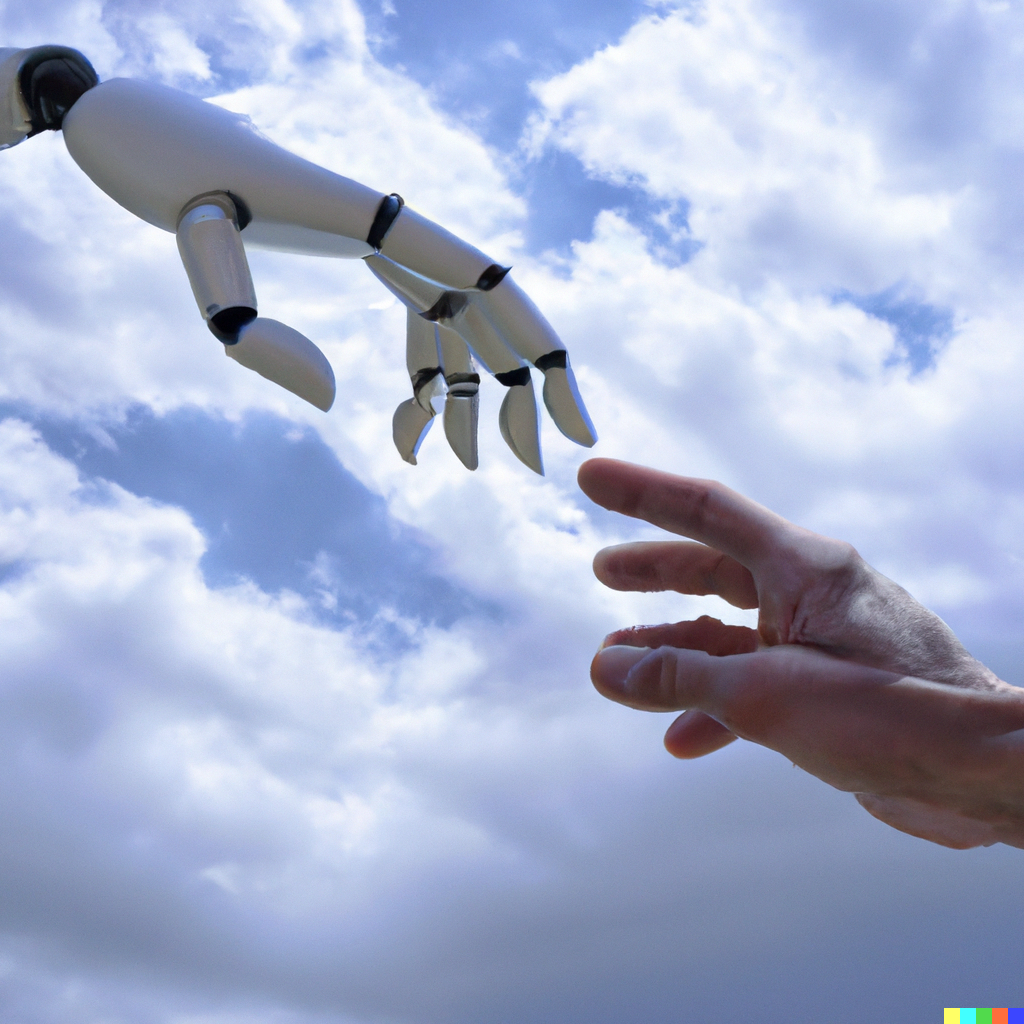

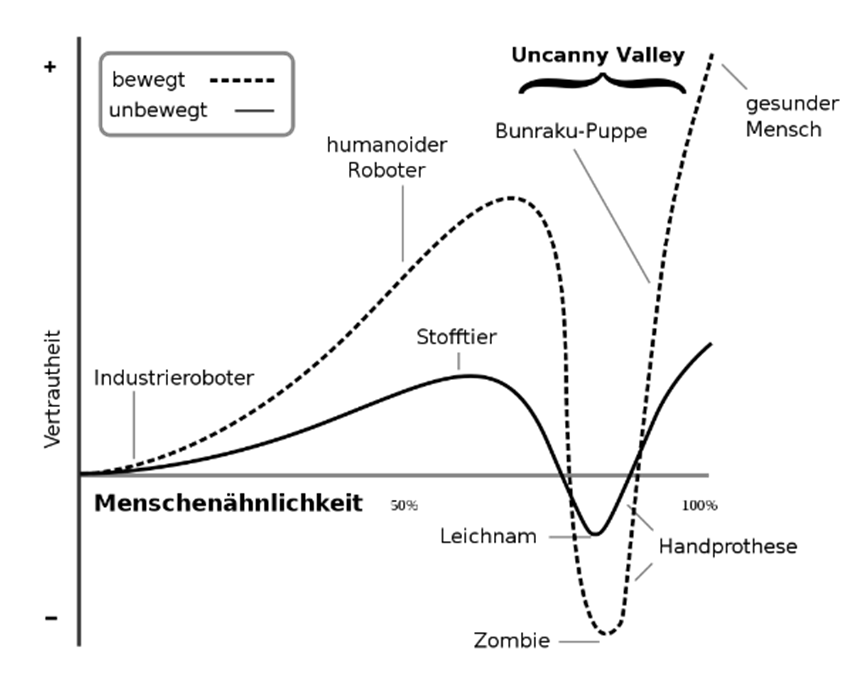

Warum aber verbleibt das Geschäftsmodell Voice Commerce so hinter seinen Erwartungen zurück? Warum werden digitale Sprachassistenten trotz ihrer Möglichkeiten vor allem eher für triviale Aktivitäten wie beispielsweise das Abspielen von Musik, das Abrufen von Wetterinformationen oder das Stellen eines Weckers verwendet? Eine Erklärung dafür liefert das Uncanny Valley. Das Phänomen des Gruselgrabens oder unheimlichen Tals wurde bereits 1970 vom japanischen Robotiker Masahiro Mori[1] beschrieben. Er wollte wissen, wie Menschen auf künstliche, aber menschenähnliche Lebensformen reagieren und entdeckte dabei ein paradoxes, U-förmiges Muster. Grundsätzlich empfinden wir es als sympathisch, wenn künstlich erschaffene Dinge unserem Aussehen ähneln. Denken sie beispielsweise an das Kindchenschema bei der Darstellung sprechender Tiere in Zeichentrickfilmen. Je mehr künstlich erstellte Lebensformen aber dem menschlichen Abbild ähneln, desto stärker kommt es ihnen gegenüber paradoxerweise zu einem Vertrauensverlust. Gerade weil wir Technik trotz aller Ähnlichkeiten als artifiziell entlarven (z.B. durch fehlende Mimik oder Emotionen), wirken sie befremdlich, gar unheimlich auf uns. Da sich der Mensch früher oder später aber an alles gewöhnt, führt eine weitere Zunahme an Ähnlichkeit auch wieder aus dem Uncanny Valley heraus. Die wahrnehmbaren Unterschiede werden weniger, das Vertrauen wieder hergestellt.

Betroffen davon ist alles, was dem Menschsein in irgendeiner Form ähnelt. Eben auch Amazons Alexa, die durch ihre sprachlichen Fähigkeiten vorgibt, eine eigenständige Persönlichkeit zu sein. Über Voice Commerce seine Einkäufe zu tätigen, erfordert Vertrauen. Sensible Daten werden außer Haus gegeben, die Transparenz ist durch eine fehlende visuelle Darstellung nicht vergleichbar mit der des herkömmlichen Online-Shoppings. Die Zurückhaltung der Konsument_innen ist verständlich, die stetige Entwicklung der künstlichen Intelligenz wird aber sicher auch diesen Bereich weiter voranbringen.

Achtung Gruselgraben!

Doch nicht nur für Alexa ist das Uncanny Valley von Bedeutung. Auch in der Fernlehre kann sich eine Akzeptanzlücke öffnen, wenn Avatare, Chatbots oder Videos mit computeranimierten Darsteller_innen zwar als menschlich, aber gleichzeitig als zu künstlich wahrgenommen werden. Ich selbst kann mich an eine Lehrveranstaltung erinnern, in der mehrere, kurze, selbst erstellte Lehrvideos mit einer computergenerierten Stimme hinterlegt wurden. Die Überlegung dahinter war, dass Artikulation und Aussprache so klarer und verständlicher sind. Das studentische Feedback dazu war überraschend: es sei anstrengend der menschenähnlichen, aber eindeutig als computergeneriert identifizierten Stimme zu folgen. Ich habe die Studierenden ungewollt aber geradewegs in den Gruselgraben geschickt. Aus dieser Erfahrung habe ich gelernt, meine selbst erstellten Lehrvideos wieder selbst zu vertonen. Ich bin zwar persönlich mit dem Ergebnis nicht immer zufrieden, als 100 % menschlich wird sie aber jedenfalls erkannt und akzeptiert. Für Alexa habe ich leider keine so einfache und rasche Lösung parat, um den Weg aus dem Gruselgraben heraus zu finden.

[1] https://en.wikipedia.org/wiki/Masahiro_Mori_(roboticist)

[2] Tobias K. (https://commons.wikimedia.org/wiki/File:Mori_Uncanny_Valley_de.svg), „Mori Uncanny Valley de“, https://creativecommons.org/licenses/by-sa/3.0/legalcode